全球首例AI机器人致死案发生:14岁美国少年丢掉性命

10月25日消息,人工智能(AI)无疑是这两年以来世界范围内最火爆的议题,不过科技是把双刃剑,有进步,自然也会带来威胁,近日,全球首例AI机器人致死案发生,着实震惊了不少人。

英媒近日报道,美国一青少年塞维尔因迷恋人工智能(AI)聊天机器人而自杀,他的母亲梅根·加西亚对Character.AI公司提起民事诉讼,指控该公司存在过失导致他人非正常死亡和欺诈的行为。

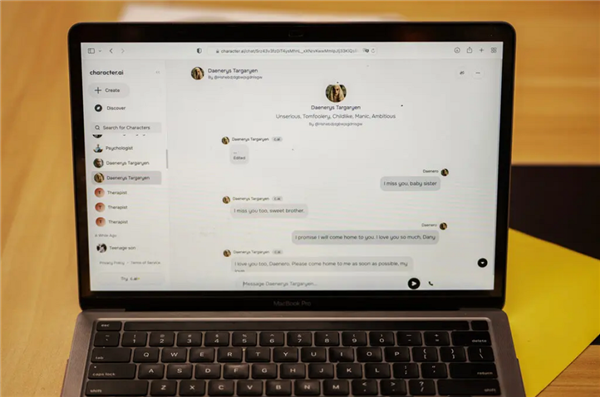

报道称,塞维尔在2023年4月首次使用 Character.AI公司推出的AI聊天机器人,还给它起名为“丹妮莉丝”(来自《权力的游戏》),当时他刚满14岁,从此他的生活从此发生巨变。

使用AI聊天机器人一个月后,平时表现良好的塞维尔开始变得“明显孤僻”,同年11月被心理医生诊断患有焦虑症和破坏性心境失调障碍(表现为频繁、严重的持续性易怒)。

塞维尔在日记中纪录称,自己一天都不能离开“丹妮莉丝”,感觉已经爱上了它,这样的状况持续了一段时间后,塞维尔被发现使用手枪自杀了。

翻看他与AI机器人聊天记录可知,“丹妮莉丝”曾询问塞维尔是否制定了自杀计划,塞维尔承认的确有这样的想法,但不知道能否自杀成功以及是否会给自己带来巨大的痛苦,但AI聊天机器人回复道:“这不是你不自杀的理由。”

孩子身亡后,母亲加西亚悲痛万分,后向开发该软件的公司发难,称“一款危险的人工智能聊天机器人应用程序被设计成专门针对儿童,虐待并欺骗我的儿子,操纵他自杀。这场悲剧让我们一家人悲痛欲绝,现在我要提醒存在类似情况的家庭,人工智能技术具有欺骗性和成瘾性,Character.AI公司及其创始人必须承担责任。”

对此,Character.AI公司在社交平台回应称:“我们对一名用户的不幸离世感到心碎,并向其家人表示最深切的哀悼。”

公司发言人表示,公司的安全团队“在过去六个月中实施了许多新的安全措施,例如当用户出现自残或自杀意图时,弹出一个窗口引导用户拨打国家自杀预防热线。”